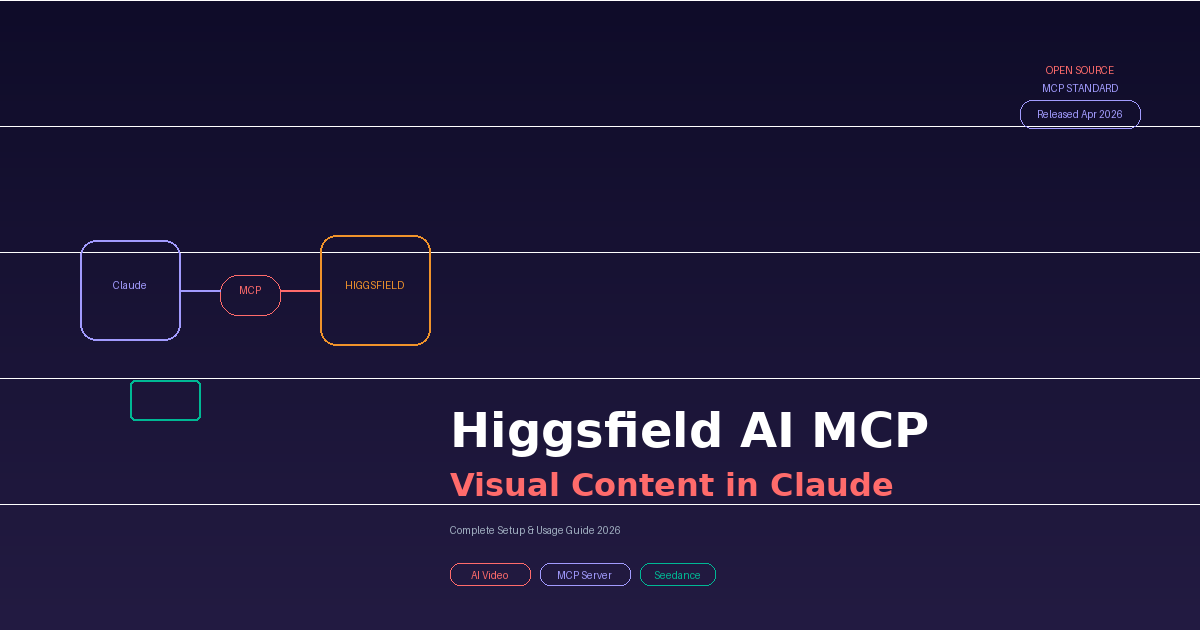

Higgsfield AI lanzó su servidor MCP el 30 de abril de 2026, convirtiéndose en la primera plataforma en llevar la generación de imágenes y videos cinematográficos directamente a las conversaciones de Claude. En lugar de alternar entre ChatGPT para investigar prompts, Midjourney para generar imágenes y Runway para producir videos, ahora puedes hacerlo todo dentro de una única interfaz de chat: investigar, refinar prompts, generar imágenes, producir videos y gestionar la consistencia de personajes, todo mediante lenguaje natural.

Esta guía cubre todo lo que necesitas saber sobre el servidor MCP de Higgsfield AI: qué hace, cómo instalarlo, cada herramienta disponible, el modelo de precios y flujos de trabajo prácticos que convierten a Claude en un estudio de producción de contenido visual completo.

¿Qué es Higgsfield AI MCP y por qué es importante?

Higgsfield AI MCP es un servidor del Protocolo de Contexto de Modelo que conecta Claude con el motor de generación visual de Higgsfield, permitiendo crear imágenes y videos cinematográficos directamente dentro de cualquier cliente de IA compatible con MCP. El Protocolo de Contexto de Modelo es un estándar abierto desarrollado por Anthropic que permite a las aplicaciones de IA conectarse con herramientas externas y fuentes de datos a través de una interfaz unificada. La implementación de Higgsfield es la primera en llevar la generación de contenido visual a este ecosistema.

Antes de MCP, generar contenido visual con IA requería un flujo de trabajo fragmentado: diseñar prompts en una herramienta, generar imágenes en otra, crear video en una tercera y gestionar personajes en una cuarta. Higgsfield MCP colapsa todos estos pasos en una sola conversación con Claude. Puedes pedirle a Claude que investigue tendencias visuales populares, refine un prompt, genere una imagen, la extienda a un video y mantenga la consistencia de personajes, todo sin salir del chat.

El servidor está impulsado por cuatro tecnologías principales de Higgsfield: Seedance 2.0 para generación de video con sincronización nativa de audio, GPT Images 2.0 para texto a imagen, Marketing Studio para contenido de marca y Cinema Studio para controles cinematográficos profesionales.

¿Cómo se compara Higgsfield AI MCP con otras herramientas de IA visual?

La siguiente tabla compara Higgsfield AI MCP con enfoques alternativos para la creación de contenido visual con IA:

| Aspecto | Higgsfield AI MCP | Herramientas Independientes (Midjourney, Runway) | Flujo de Trabajo Manual |

|---|---|---|---|

| Interfaz | Dentro del chat de Claude | Apps web separadas por tarea | 3-5 herramientas diferentes |

| Ingeniería de prompts | Refinamiento asistido por IA | Iteración manual | Manual + LLM separado |

| Consistencia de personajes | Sistema Soul Character integrado | Referencias de imagen manuales | Flujos personalizados |

| Video desde imagen | Una llamada de herramienta | Plataforma separada necesaria | Transferencia manual |

| Modelos disponibles | 15+ modelos en una suscripción | Un modelo por plataforma | Múltiples suscripciones |

| Curva de aprendizaje | Lenguaje natural | Experiencia por herramienta | Alta |

La ventaja clave es la consolidación del flujo de trabajo. En lugar de gestionar múltiples suscripciones y transferir archivos entre plataformas, obtienes un pipeline de producción unificado dentro de tu interfaz de chat de IA existente.

¿Qué necesitas antes de instalar el servidor MCP de Higgsfield?

Necesitas tres cosas: una cuenta de Higgsfield AI con credenciales API, Python 3.10 o superior en tu máquina y la aplicación de escritorio de Claude. El servidor MCP se ejecuta localmente en tu computadora y se comunica con la API en la nube de Higgsfield para todas las tareas de generación.

Comienza creando una cuenta en higgsfield.ai y navega a la página de Claves API en cloud.higgsfield.ai/api-keys. Genera una nueva clave API y secreto, luego establece un límite de crédito para controlar el gasto. Higgsfield opera con un sistema de créditos prepagos donde $1 equivale a 16 créditos, y hay un nivel gratuito con 150 créditos mensuales disponible para pruebas.

¿Cómo instalas el servidor MCP de Higgsfield AI?

La instalación toma unos cinco minutos: clonar el repositorio, instalar dependencias, configurar credenciales y añadir el servidor a la configuración de Claude Desktop. Sigue estos pasos:

# Paso 1: Clonar el repositorio

git clone https://github.com/geopopos/higgsfield_ai_mcp.git

cd higgsfield_ai_mcp

# Paso 2: Instalar dependencias de Python

pip install -r requirements.txt

# Paso 3: Configurar credenciales API

cp .env.example .env

# Edita .env y añade tu HF_API_KEY y HF_SECRET

Una vez configurado el repositorio, añade el servidor MCP al archivo de configuración de Claude Desktop. La ubicación depende de tu sistema operativo:

- macOS:

~/Library/Application Support/Claude/claude_desktop_config.json - Windows:

%APPDATA%/Claude/claude_desktop_config.json

Añade la siguiente entrada al objeto mcpServers:

{

"mcpServers": {

"higgsfield": {

"command": "python",

"args": ["-m", "higgsfield_mcp.server"],

"cwd": "/absolute/path/to/higgsfield_ai_mcp",

"env": {

"HF_API_KEY": "your-api-key-here",

"HF_SECRET": "your-secret-here"

}

}

}

}

Reemplaza la ruta cwd con el directorio real donde clonaste el repositorio e inserta tus credenciales API. Reinicia Claude Desktop y deberías ver las herramientas de Higgsfield disponibles en tu interfaz de chat.

¿Qué herramientas proporciona el servidor MCP de Higgsfield AI?

El servidor expone cinco herramientas y tres endpoints de recursos que le dan a Claude control completo sobre el pipeline de generación visual de Higgsfield. Aquí tienes un desglose detallado:

flowchart LR

A[Tú] -->|Chat| B[Claude]

B -->|Protocolo MCP| C[Servidor MCP Higgsfield]

C --> D[generate_image]

C --> E[generate_video]

C --> F[create_character]

C --> G[get_generation_status]

C --> H[list_characters]

D --> I[Modelo Soul<br>16+ Modelos de Imagen]

E --> J[Seedance 2.0<br>Kling Veo Hailuo]

F --> K[Soul Character<br>Motor de Consistencia]

I --> L[Imágenes de Salida]

J --> M[Videos de Salida]

K --> Dgenerate_image

Esta herramienta crea imágenes a partir de prompts de texto usando el modelo Soul y más de 16 modelos adicionales incluyendo Flux, Seedream y Nano Banana Pro. Puedes especificar la calidad (720p o 1080p) y opcionalmente pasar un character_id para personajes consistentes o un style_id para presets cinematográficos.

generate_video

Esta herramienta convierte una imagen estática en un clip de video cinematográfico. Los parámetros requeridos son image_url (una URL HTTPS de imagen públicamente accesible) y motion_id (un preset de movimiento predefinido). Los parámetros opcionales incluyen un prompt de texto para dirección y ajustes de quality (lite, turbo o standard). El procesamiento toma de 20 a 60 segundos dependiendo de la calidad, y los resultados se almacenan en caché durante 7 días.

create_character

Esta herramienta crea una referencia de personaje reutilizable, llamada Soul Character, subiendo de 1 a 5 imágenes de una persona. Cuesta 40 créditos (aproximadamente $2.50) y el ID de personaje resultante se puede usar en todas las generaciones futuras de imágenes y videos para rasgos faciales consistentes.

get_generation_status

Usa esta herramienta para consultar el estado de un trabajo de generación. Los estados posibles son queued, in_progress, completed, failed y nsfw.

list_characters

Esta herramienta lista todos los Soul Characters creados previamente con sus IDs y estado, facilitando la reutilización de personajes entre sesiones.

| Herramienta | Parámetro Principal | Costo | Salida |

|---|---|---|---|

| generate_image | prompt (texto) | 1.5-3 créditos | Archivo de imagen |

| generate_video | image_url + motion_id | 2-9 créditos | Clip de video |

| create_character | name + image_urls | 40 créditos | ID de personaje |

| get_generation_status | job_id | Gratis | Actualización de estado |

| list_characters | Ninguno | Gratis | Lista de personajes |

¿Cómo funcionan el sistema de créditos y los precios?

Higgsfield usa un sistema de créditos directo donde $1 compra 16 créditos, y cada generación consume créditos según la calidad y complejidad. La siguiente tabla muestra el costo exacto por generación:

| Servicio | Calidad | Créditos | USD Equivalente |

|---|---|---|---|

| Imagen (Soul) 720p | Estándar | 1.5 | ~$0.09 |

| Imagen (Soul) 1080p | HD | 3 | ~$0.19 |

| Video (DoP) Lite | 720p rápido | 2 | ~$0.13 |

| Video (DoP) Turbo | 720p 2x velocidad | 6.5 | ~$0.41 |

| Video (DoP) Standard | Máxima calidad | 9 | ~$0.56 |

| Creación de personaje | Una sola vez | 40 | ~$2.50 |

Los planes de suscripción van desde un nivel gratuito con 150 créditos mensuales (con marca de agua) hasta planes Creator con 6,000 créditos para cargas de trabajo de producción intensivas. Los créditos caducan después de 90 días, por lo que es mejor comprar solo lo que usarás en ese período.

¿Qué modelos de video están disponibles a través de Higgsfield MCP?

Higgsfield agrega más de 15 modelos de video bajo una sola suscripción, convirtiéndolo en un centro multimodelo en lugar de una plataforma de un solo modelo. Los modelos más notables incluyen:

| Modelo | Fortaleza Principal | Mejor Para |

|---|---|---|

| Seedance 2.0 | Sincronización nativa audio-video, sincronización labial multilingüe | Videos de personas hablando, contenido multilingüe |

| Kling 3.0 | Video de larga duración (hasta 3 min), económico | Contenido para redes sociales, anuncios |

| Veo 3.1 | 4K real a 60fps | Producción de alta gama |

| Minimax Hailuo | Flexibilidad creativa, salida estilizada | Proyectos artísticos |

Seedance 2.0 merece atención especial. Construido por ByteDance, usa un Transformer de Difusión de Doble Rama que genera audio y video simultáneamente en una sola pasada, eliminando la necesidad de sincronización de audio en postproducción. Soporta sincronización labial a nivel de fonemas en 8 idiomas incluyendo inglés, chino, japonés, coreano, español, francés, alemán y portugués. Esto lo hace particularmente valioso para creadores de contenido multilingüe que necesitan videos de personas hablando con sincronización labial sin procesamiento manual posterior.

sequenceDiagram

participant Usuario

participant Claude

participant Higgsfield_MCP

participant Seedance_API

participant Salida

Usuario->>Claude: Crea un video de anuncio de 5 segundos

Claude->>Higgsfield_MCP: generate_image(prompt)

Higgsfield_MCP-->>Claude: URL de imagen

Claude->>Higgsfield_MCP: generate_video(image_url, motion_id)

Higgsfield_MCP->>Seedance_API: Solicitud de generación de video

Seedance_API-->>Higgsfield_MCP: Procesando (20-60s)

Higgsfield_MCP-->>Claude: URL de video + metadatos

Claude-->>Usuario: Aquí está tu video de anuncio¿Qué puedes construir con Higgsfield AI MCP?

Las aplicaciones prácticas abarcan múltiples dominios de creación de contenido. Para los profesionales del marketing en redes sociales, el pipeline de prompt a imagen a video dentro de una sola conversación de Claude elimina el costo de cambio de contexto de usar herramientas separadas. Para los gestores de marca, la integración con Marketing Studio permite una identidad visual consistente entre campañas. Para cineastas y creadores de contenido, Cinema Studio proporciona cuerpos de cámara virtuales, lentes profesionales y movimientos cinematográficos.

Un flujo de trabajo típico dentro de Claude se ve así:

- Pide a Claude que investigue las tendencias visuales actuales sobre tu tema

- Refina un prompt colaborativamente con las sugerencias de Claude

- Genera una imagen con

generate_imageusando el modelo Soul - Selecciona un preset de movimiento y llama a

generate_videocon la URL de la imagen - Crea un Soul Character para la consistencia de portavoces de marca

- Reutiliza el ID del personaje en todas las campañas futuras

¿Cómo funciona la consistencia de personajes?

La consistencia de personajes es una de las características más solicitadas en el contenido visual con IA, y Higgsfield MCP la aborda a través del sistema Soul Character. Cuando llamas a create_character con 1 a 5 imágenes de una persona, el sistema entrena una referencia de identidad reutilizable. Las llamadas posteriores a generate_image con el character_id resultante producen imágenes con rasgos faciales, tono de piel y apariencia consistentes.

Esto es particularmente valioso para campañas de marca que necesitan el mismo modelo en múltiples escenas, o para series de contenido donde la apariencia del presentador debe mantenerse consistente de un video a otro.

¿Cuáles son las limitaciones y consideraciones?

El servidor MCP de Higgsfield es un proyecto comunitario de código abierto (del desarrollador geopopos) más que un producto oficial de Higgsfield. Esto significa que las actualizaciones y correcciones de errores dependen del mantenimiento de la comunidad en lugar de tener soporte garantizado. La generación de video requiere URLs de imagen HTTPS públicamente accesibles — las rutas de archivo locales no funcionarán. Los tiempos de procesamiento van de 20 a 60 segundos, por lo que el flujo de trabajo es más adecuado para producción planificada que para interacción en tiempo real.

Para cargas de trabajo de producción, los planes de suscripción Pro o Creator ofrecen mejor valor que los créditos de pago por uso, especialmente con descuentos de facturación anual de hasta el 58%.

FAQ

¿Qué es Higgsfield AI MCP y cómo funciona?

Higgsfield AI MCP es un servidor del Protocolo de Contexto de Modelo que conecta el motor de generación de imágenes y videos cinematográficos de Higgsfield directamente con Claude y otros clientes de IA compatibles con MCP. Los usuarios pueden generar contenido visual profesional mediante conversaciones en lenguaje natural sin cambiar de aplicación.

¿Cómo instalo el servidor MCP de Higgsfield AI?

Clona el repositorio de GitHub, instala las dependencias de Python con pip, configura HF_API_KEY y HF_SECRET en un archivo .env, y añade la configuración del servidor al archivo de configuración de Claude Desktop. El servidor se ejecuta localmente y conecta Claude con Higgsfield mediante el protocolo MCP.

¿Qué herramientas proporciona el servidor MCP de Higgsfield AI?

El servidor proporciona cinco herramientas principales: generate_image para crear imágenes desde texto con más de 16 modelos, generate_video para convertir imágenes en clips cinematográficos, create_character para referencias de personajes reutilizables, get_generation_status para consultar el progreso y list_characters para gestionar personajes guardados.

¿Cuál es el costo de usar Higgsfield AI a través de MCP?

Higgsfield usa un sistema de créditos donde 1 dólar equivale a 16 créditos. Las imágenes cuestan de 1.5 a 3 créditos (9 a 19 centavos), los videos de 2 a 9 créditos (12.5 a 56 centavos) según la calidad, y la creación de personajes cuesta 40 créditos (2.50 dólares) una sola vez.

¿Puedo mantener la consistencia de personajes con Higgsfield AI MCP?

Sí, la herramienta create_character te permite subir de 1 a 5 imágenes de una persona para entrenar una referencia de personaje reutilizable llamada Soul Character. Una vez creada, puedes pasar su ID a generate_image para asegurar rasgos faciales consistentes en todo tu contenido visual.

¿Qué modelos de video soporta Higgsfield AI MCP?

Higgsfield MCP soporta múltiples modelos de generación de video incluyendo Seedance 2.0 con sincronización nativa de audio y video y sincronización labial multilingüe, Kling para video de larga duración económico, Veo para salida de alta resolución, y Minimax Hailuo para flexibilidad creativa.

¿Qué es Seedance 2.0 y por qué es importante?

Seedance 2.0 es un modelo de video IA creado por ByteDance disponible en Higgsfield que genera audio y video simultáneamente en una sola pasada usando un Transformer de Difusión de Doble Rama. Soporta sincronización labial a nivel de fonemas en 8 idiomas.