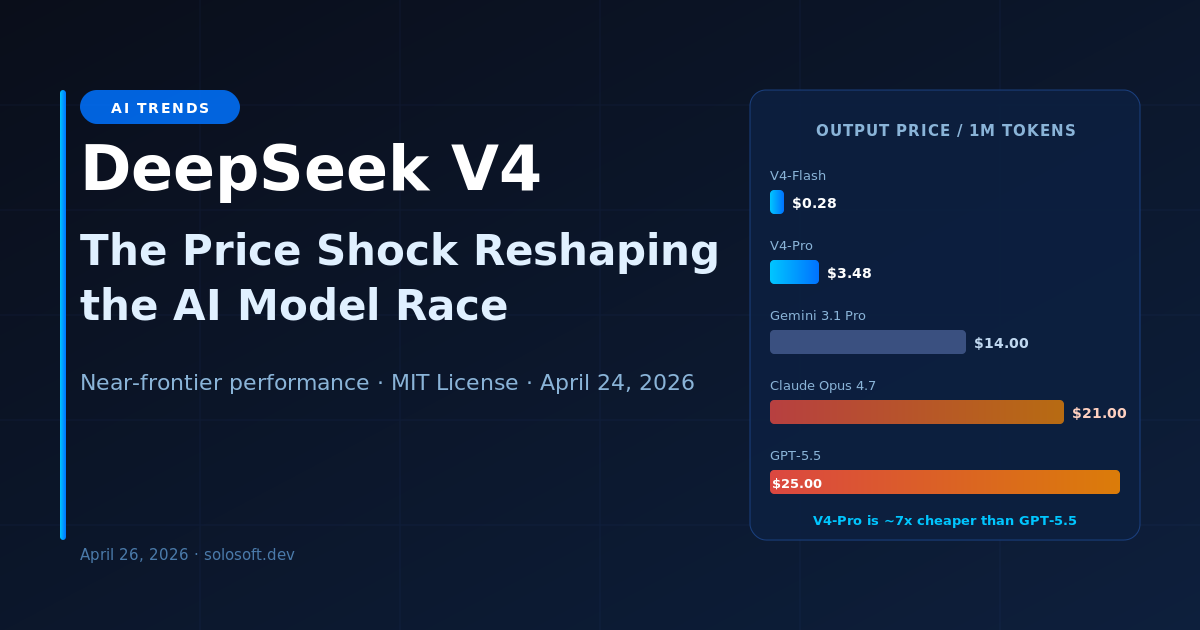

El 24 de abril de 2026, DeepSeek lanzó dos nuevos modelos — V4-Pro y V4-Flash — que sacudieron inmediatamente los supuestos de precios de todos los presupuestos empresariales de IA. El costo de salida de V4-Pro es de $3.48 por millón de tokens, aproximadamente un séptimo del precio de GPT-5.5 y un sexto del de Claude Opus 4.7. Para equipos que operan a cualquier escala — asistentes de código en producción, pipelines RAG, automatización de atención al cliente — la aritmética es difícil de ignorar. Este no es un lanzamiento incremental menor. Es la última entrada en lo que se está convirtiendo en una guerra de precios estructural, donde los laboratorios de IA chinos están usando arquitecturas eficientes en capital y costos operativos más bajos para comprimir el costo por unidad de inteligencia más rápido de lo que el mercado puede absorber.

La historia es más grande que el precio. DeepSeek V4-Pro obtiene 80.6% en SWE-bench Verified, solo 0.2 puntos por detrás de Claude Opus 4.6 — el modelo estadounidense actualmente en el primer puesto. En benchmarks de código que miden rendimiento real en producción, como LiveCodeBench y Terminal-Bench 2.0, V4-Pro en realidad lidera todos los modelos de frontera. El lanzamiento también señala algo estratégicamente importante: DeepSeek ha profundizado su integración con los chips Ascend de Huawei, una respuesta directa a los controles de exportación de EE.UU. sobre hardware de Nvidia. Lo que comenzó como una restricción ha evolucionado hacia una estrategia de cadena de suministro. La carrera de IA en 2026 se libra simultáneamente en benchmarks, precios e independencia de chips.

¿Qué es DeepSeek V4 y por qué importa?

DeepSeek V4 es una familia de dos modelos — V4-Pro y V4-Flash — ambos construidos sobre arquitectura Mixture-of-Experts y lanzados bajo licencia MIT el 24 de abril de 2026. V4-Pro apunta al máximo rendimiento con 1.6 billones de parámetros totales (49B activos por token), mientras que V4-Flash apunta a la eficiencia con 284 mil millones de parámetros totales (13B activos). Ambos fueron entrenados en 32–33 billones de tokens y cuentan con una ventana de contexto de 1 millón de tokens habilitada por la Arquitectura de Atención Híbrida.

Lo que importa es la combinación: rendimiento casi de frontera, pesos abiertos, licencia MIT y un precio que subestima a cada competidor estadounidense por un factor de seis a diez. Para el mercado empresarial, la pregunta ya no es “¿podemos permitirnos la IA de frontera?” sino “¿por qué pagamos precios de frontera para tareas donde V4-Pro es suficientemente bueno?”

¿Cómo se compara DeepSeek V4 con OpenAI y Anthropic?

DeepSeek V4-Pro entrega rendimiento dentro de 3 a 6 meses de la frontera absoluta en la mayoría de benchmarks, al costo de API de un séptimo. En tareas específicas de código — las que representan la mayoría del gasto empresarial en LLMs — lidera a todos los competidores directamente.

| Modelo | Proveedor | Paráms Totales | Paráms Activos | Ventana Contexto | SWE-bench Verificado | Precio Salida / 1M tokens |

|---|---|---|---|---|---|---|

| DeepSeek V4-Pro | DeepSeek | 1.6T | 49B | 1M tokens | 80.6% | $3.48 |

| DeepSeek V4-Flash | DeepSeek | 284B | 13B | 1M tokens | ~65% | $0.28 |

| Claude Opus 4.7 | Anthropic | No divulgado | No divulgado | 200K tokens | ~82% | ~$21.00 |

| GPT-5.5 | OpenAI | No divulgado | No divulgado | 128K tokens | ~81% | ~$25.00 |

| Gemini 3.1 Pro | No divulgado | No divulgado | 2M tokens | ~79% | ~$14.00 |

La tabla revela la tensión central: si el rendimiento en SWE-bench Verified está dentro de 1 a 2 puntos en todos los modelos, la brecha de precio de 6 a 10 veces se convierte en la variable de decisión dominante para la mayoría de las cargas de trabajo en producción.

¿Qué hace tan eficiente la arquitectura de V4-Pro?

DeepSeek V4 usa una arquitectura Mixture-of-Experts (MoE) — un diseño que activa solo una pequeña fracción del total de parámetros para cada token. En lugar de enrutar cada entrada a través de los 1.6 billones de parámetros, V4-Pro activa solo 49 mil millones por token. Esto reduce dramáticamente los costos de cómputo sin sacrificar la capacidad que proviene de un gran conteo de parámetros.

flowchart TD

Input[Flujo de Tokens de Entrada] --> Router[Router MoE con Compuerta<br>Aprendido por Tipo de Token]

Router --> E1[Expertos en Codigo]

Router --> E2[Expertos en Razonamiento]

Router --> E3[Expertos en Lenguaje]

Router --> EN[Expertos de Dominio N]

E1 --> Agg[Agregacion de Salida Ponderada]

E2 --> Agg

E3 --> Agg

EN --> Agg

Agg --> Out[Respuesta Final del Modelo]Combinado con la Arquitectura de Atención Híbrida, que extiende la memoria efectiva a través de 1 millón de tokens, V4-Pro logra lo que la mayoría de los usuarios empresariales realmente necesitan: contexto grande, código fuerte y razonamiento razonable — a un costo de inferencia que escala con el conteo de parámetros activos, no el total.

¿Qué cuesta DeepSeek V4 y cómo se compara?

La brecha de precios entre DeepSeek V4 y los modelos de frontera estadounidenses no es un error de redondeo — es una diferencia de base de costos estructural que se capitaliza a escala.

| Modelo | Precio Entrada / 1M tokens | Precio Salida / 1M tokens | Precio Entrada en Caché / 1M tokens | Licencia |

|---|---|---|---|---|

| DeepSeek V4-Flash | $0.07 | $0.28 | $0.018 | MIT |

| DeepSeek V4-Pro | $1.74 | $3.48 | $0.43 | MIT |

| Gemini 3.1 Pro | ~$5.00 | ~$14.00 | ~$1.25 | Propietaria |

| Claude Opus 4.7 | ~$7.00 | ~$21.00 | ~$1.75 | Propietaria |

| GPT-5.5 | ~$10.00 | ~$25.00 | ~$2.50 | Propietaria |

Con 10 mil millones de tokens de salida al mes — un volumen realista para una empresa mediana con herramientas activas de IA — la diferencia de costo mensual entre V4-Pro y GPT-5.5 es de aproximadamente $215 millones versus $250 millones. Escalado a un año, el ahorro supera el costo de desplegar un equipo de IA interno.

¿En qué benchmarks gana realmente DeepSeek V4-Pro?

DeepSeek V4-Pro lidera el campo en benchmarks de código mientras se queda ligeramente por detrás de la frontera absoluta en razonamiento amplio y tareas de conocimiento. Esta es una optimización deliberada: las cargas de trabajo donde las empresas gastan más cómputo son también las cargas donde V4-Pro rinde mejor.

| Benchmark | DeepSeek V4-Pro | Claude Opus 4.6 | GPT-5.5 | Gemini 3.1 Pro | Qué Mide |

|---|---|---|---|---|---|

| SWE-bench Verificado | 80.6% | 80.8% | ~81.0% | ~79.0% | Resolución real de issues en GitHub |

| LiveCodeBench | 93.5% | 88.8% | ~90.0% | ~88.5% | Problemas de programación competitiva |

| Terminal-Bench 2.0 | 67.9% | 65.4% | ~64.0% | ~63.0% | Completar tareas CLI de forma autónoma |

| Puntuación Codeforces | 3206 | ~3150 | ~3100 | ~3050 | Ranking programación competitiva |

| MMLU Pro | ~76% | ~80% | ~81% | ~80% | Conocimiento nivel posgrado |

| Humanity’s Last Exam | ~44% | ~52% | ~54% | ~51% | Razonamiento nivel doctorado |

¿Por qué la integración con chips Huawei señala más que un simple acuerdo de hardware?

La estrecha integración de DeepSeek V4 con los chips Ascend de Huawei no es un plan de respaldo — es una declaración estratégica de que el stack de IA chino puede funcionar a escala casi de frontera sin hardware de Nvidia.

flowchart LR

V1[DeepSeek V1<br>2023<br>Primer Modelo Abierto] --> V2[DeepSeek V2<br>2024<br>Arquitectura MoE]

V2 --> R1[DeepSeek R1<br>Enero 2025<br>Shock en Razonamiento]

R1 --> V3[DeepSeek V3<br>Dic 2024<br>Claims en Benchmarks]

V3 --> V4[DeepSeek V4-Pro<br>Abr 2026<br>Precio e Independencia]La integración con Ascend tiene tres implicaciones estratégicas: reduce la exposición a futuras sanciones de hardware de EE.UU.; crea un stack de IA chino verticalmente integrado que no depende de la cadena de suministro de EE.UU. en ninguna capa; y demuestra que los chips Ascend de Huawei pueden entrenar y servir modelos a escala casi de frontera cuando el software está optimizado para ellos.

¿Cómo deben responder las empresas a esta disrupción de precios?

La respuesta racional al lanzamiento de DeepSeek V4 es una auditoría sistemática de cargas de trabajo, no una migración total. Las empresas deben mapear su gasto actual en LLMs por tipo de tarea, evaluar la paridad de benchmarks para cada caso de uso y calcular la oportunidad real de ahorro de costos antes de realizar cambios de infraestructura.

La implicación estratégica más profunda es esta: DeepSeek V4 es el segundo lanzamiento de un modelo chino en 15 meses (tras R1 en enero de 2025) que ha forzado a la industria de IA de EE.UU. a reconsiderar sus supuestos de precios. Si este ritmo continúa, el costo de inteligencia casi de frontera se acercará a cero para la mayoría de las cargas de trabajo en dos o tres años. El foso defensible no es el acceso a tokens baratos, sino datos propietarios, confianza del usuario y profundidad de flujo de trabajo que ningún cambio de modelo puede replicar.

Preguntas Frecuentes

¿Qué es DeepSeek V4 y cuándo fue lanzado? DeepSeek V4 es una familia de modelos lanzada el 24 de abril de 2026, con V4-Pro y V4-Flash usando arquitectura MoE y licencia MIT para uso comercial gratuito.

¿Cómo se comparan los precios de DeepSeek V4-Pro con GPT-5.5? V4-Pro cuesta $3.48 por millón de tokens de salida, aproximadamente un séptimo del precio de GPT-5.5 y un sexto del de Claude Opus 4.7.

¿En qué benchmarks de código lidera V4-Pro? Lidera en Terminal-Bench 2.0 (67.9%), LiveCodeBench (93.5%) y Codeforces (3206); en SWE-bench Verificado alcanza 80.6%.

¿Es DeepSeek V4 de código abierto? Sí, bajo licencia MIT. Los pesos pueden descargarse, ajustarse y desplegarse comercialmente sin costo por token.

¿Qué es la Arquitectura de Atención Híbrida? Una técnica que habilita una ventana de contexto de 1 millón de tokens, permitiendo enviar bases de código completas como un único prompt.

¿Deberían las empresas migrar a DeepSeek V4? Las cargas de trabajo de código y documentos son candidatas fuertes. Las industrias reguladas deben evaluar residencia de datos y cumplimiento antes de migrar.