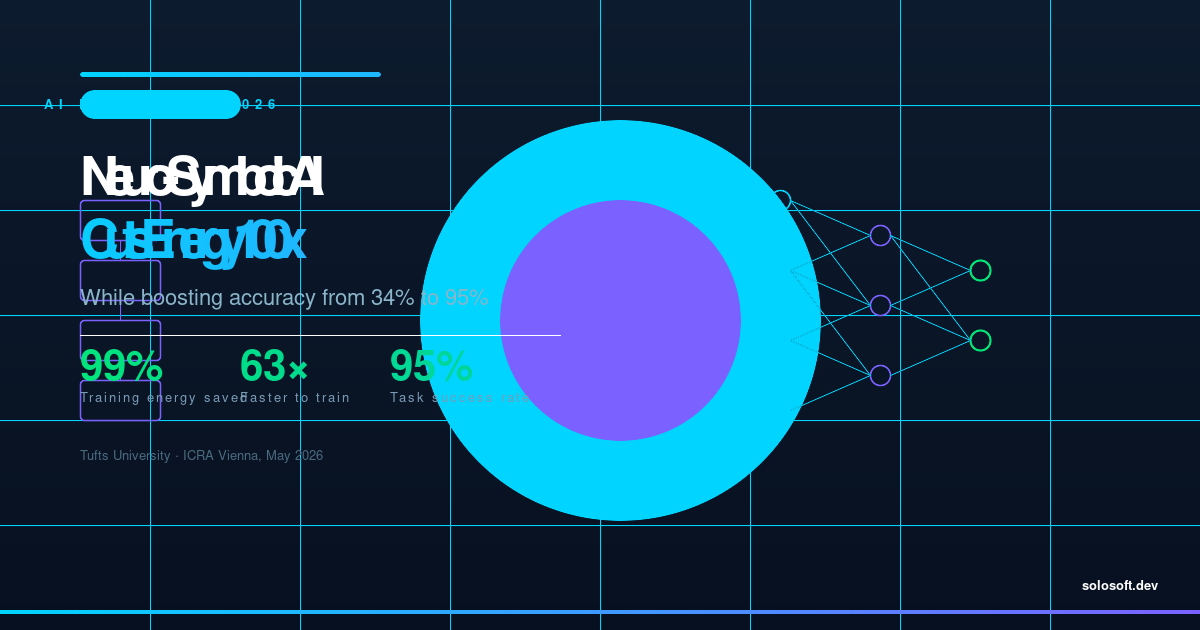

La industria de la IA ha pasado los últimos cinco años escalando para obtener modelos más inteligentes —añadiendo parámetros, quemando más cómputo y consumiendo electricidad a un ritmo que ha alarmado a los operadores de redes eléctricas desde Virginia hasta Singapur. En abril de 2026, un equipo de investigación de la Universidad Tufts entregó un resultado que desafía el supuesto central de esa estrategia: más grande no tiene que ser más costoso. Su modelo neuro-simbólico de acción-lenguaje-visión completó una exigente tarea de planificación con una tasa de éxito del 95 por ciento usando solo el uno por ciento de la energía requerida por los modelos de aprendizaje profundo estándar durante el entrenamiento y cinco por ciento durante la operación. El tiempo de entrenamiento se derrumbó de más de 36 horas a 34 minutos. El hallazgo —que se presentará en la Conferencia Internacional sobre Robótica y Automatización en Viena en mayo de 2026— llega en un momento en que la crisis energética de la IA ha pasado de preocupación teórica a emergencia operacional. Los hiperescaladores están firmando acuerdos de compra de energía nuclear por décadas, y la demanda de electricidad de los centros de datos se proyecta que se triplicará para 2030 incluso en escenarios conservadores de adopción de IA. Una técnica que logra mejor precisión con el uno por ciento de la energía de entrenamiento no es simplemente una curiosidad académica —es un desafío directo a la economía de capital de cada laboratorio de frontera y cada empresa que despliega IA a escala.

¿Qué es la IA neuro-simbólica, y por qué importa ahora?

La IA neuro-simbólica fusiona dos tradiciones de investigación históricamente separadas: las redes neuronales, que aprenden patrones estadísticos de datos brutos, y el razonamiento simbólico, que codifica reglas estructuradas y relaciones lógicas como los humanos organizamos el conocimiento. Los modelos estándar de aprendizaje profundo tratan cada problema —incluyendo tareas de planificación secuencial— como un desafío de coincidencia de patrones, requiriendo enormes cantidades de datos de entrenamiento y cómputo para aproximar el comportamiento correcto. Los sistemas neuro-simbólicos descomponen primero los problemas en subpasos lógicos, dejando que el motor simbólico maneje la estructura mientras el componente neuronal maneja la percepción. El resultado es un modelo que razona en lugar de adivinar, y razonar es computacionalmente barato comparado con el descenso de gradiente por fuerza bruta sobre miles de millones de parámetros.

El momento importa porque 2026 es el año en que la IA agéntica —sistemas que autónomamente planifican, deciden y ejecutan flujos de trabajo de múltiples pasos— se convirtió en la expectativa estándar empresarial. Cada lanzamiento importante de modelo este trimestre enfatizó capacidades agénticas. Las tareas agénticas son exactamente donde brilla el razonamiento simbólico: requieren toma de decisiones secuenciales confiables, no solo generación fluida de texto. Las arquitecturas neuro-simbólicas pueden estar por tanto mejor alineadas con las cargas de trabajo reales que las empresas quieren desplegar que el enfoque puro de transformer.

¿Cómo funciona realmente el avance de Tufts?

El equipo de Tufts, liderado por Matthias Scheutz, Karol Family Applied Technology Professor, construyó su modelo alrededor de tareas de manipulación robótica — específicamente la Torre de Hanói, un problema clásico de planificación que requiere mover discos entre postes sin colocar nunca un disco mayor sobre uno menor. La tarea exige razonamiento secuencial correcto a lo largo de muchos pasos; la aproximación estadística aleatoria falla gravemente.

Su arquitectura empareja un módulo de percepción neuronal —que identifica objetos e infiere relaciones espaciales a partir de input visual— con un planificador simbólico que genera una secuencia de acciones explícita usando algoritmos clásicos de planificación de IA. El módulo neuronal no necesita aprender planificación desde cero; solo necesita percibir con suficiente precisión para alimentar al planificador simbólico con inputs correctos. Esta división del trabajo elimina la gran mayoría de ejemplos de entrenamiento que un modelo puramente neuronal necesitaría para internalizar la lógica de planificación a través de prueba y error.

| Métrica | Modelo VLA Estándar | Modelo Neuro-Simbólico |

|---|---|---|

| Tasa de éxito en tareas | 34% | 95% |

| Tiempo de entrenamiento | 36+ horas | 34 minutos |

| Energía de entrenamiento (relativa) | 100% | 1% |

| Energía de inferencia (relativa) | 100% | 5% |

| Tipo de arquitectura | Neuronal de extremo a extremo | Neuronal + planificador simbólico |

La brecha de éxito del 95 vs 34 por ciento no es ruido —refleja una diferencia cualitativa en cómo los dos enfoques abordan la planificación. El modelo estándar a veces tuvo suerte con secuencias cortas; el modelo neuro-simbólico resolvió el puzzle completo de manera confiable porque su planificador simbólico garantizó la corrección estructural, mientras el componente neuronal manejó el desordenado problema de percepción del mundo real.

¿Por qué es el consumo energético de IA un problema de primer orden en 2026?

La demanda energética de IA ha escalado de punto de conversación a restricción real de infraestructura. Entrenar modelos de clase GPT-4 consumió aproximadamente 50 GWh. Las estimaciones para entrenar la próxima generación de modelos de billones de parámetros llegan a 1,000 GWh o más —comparable al consumo anual de electricidad de una ciudad de tamaño mediano. La inferencia es la preocupación a largo plazo más grande: a medida que las empresas despliegan IA en producción a escala, la carga de inferencia supera la energía de entrenamiento por un orden de magnitud.

| Inversión en Infraestructura | Organización | Escala |

|---|---|---|

| PPAs nucleares firmados 2025–2026 | Microsoft, Google, Amazon | Múltiples plantas de 1–3 GW |

| Nueva capacidad de centros de datos 2026 | Solo EE.UU. | ~30 GW proyectados |

| Participación de IA en electricidad global | Proyección IEA 2030 | 3–4% del consumo total |

| Ejecución de entrenamiento promedio (LLM frontera) | Top-3 laboratorio | 50–200 GWh |

La presión económica es tan significativa como la ambiental. El cómputo GPU es el elemento de costo único más grande para laboratorios de IA y despliegues empresariales por igual. Un modelo que logra mejor precisión con el 1 por ciento de la energía de entrenamiento representa una reducción potencial de 99 veces en el costo de cómputo para la fase de entrenamiento — un número que cambia el caso de negocio para desplegar IA en entornos con recursos limitados, desde robots industriales hasta dispositivos de borde en mercados emergentes.

¿Desafía esto las leyes de escala que han impulsado a la industria?

Sí — parcial e importantemente. Las leyes de escala establecidas por Kaplan et al. y refinadas posteriormente por Chinchilla describen cómo mejora el rendimiento del modelo a medida que los parámetros y los datos de entrenamiento aumentan en conjunto. Han sido la estrella del norte de la inversión en IA de frontera desde 2020: más cómputo significa mejores modelos.

El resultado neuro-simbólico no refuta las leyes de escala para modelos de lenguaje de propósito general. Lo que demuestra es que para tareas estructuradas y orientadas a la acción —un subconjunto grande y creciente de las cargas de trabajo de IA empresarial— el supuesto de que debes escalar los componentes neuronales para lograr alta precisión es incorrecto. Un componente neuronal más pequeño emparejado con un razonador simbólico puede superar a un sistema puramente neuronal mucho más grande en tareas que tienen estructura lógica.

graph TD

A[Input de Percepcion<br>Camara y Sensores] --> B[Modulo de Percepcion Neuronal<br>Deteccion de Objetos + Mapeo Espacial]

B --> C[Planificador Simbolico<br>Algoritmo Clasico de Planificacion IA]

C --> D[Secuencia de Acciones<br>Plan Estructurado Paso a Paso]

D --> E[Capa de Ejecucion<br>Robot y Agente y Motor de Flujo]

E --> F[Tarea Completada<br>95% Tasa de Exito]

G[Aprendizaje Profundo Estandar<br>Neuronal Puro de Extremo a Extremo] --> H[Aproximacion Estadistica<br>34% Tasa de Exito]

style A fill:#e8f4f8

style F fill:#d4edda

style H fill:#f8d7daLa implicación estratégica es que la industria se bifurcará: los laboratorios de frontera continuarán escalando transformers para razonamiento de extremo abierto, mientras que los proveedores de robótica, automatización e IA de borde adoptarán cada vez más arquitecturas híbridas que son precisas, eficientes e interpretables. Las empresas que evalúan proveedores de IA en 2026 deberían preguntar explícitamente qué paradigma usa su proveedor y si coincide con la estructura de la tarea real.

¿Cuáles son las implicaciones para el despliegue empresarial de IA?

El panorama empresarial de IA en abril de 2026 se está consolidando rápidamente. A pesar del financiamiento de capital de riesgo récord en Q1 —$300 mil millones globalmente, con cuatro laboratorios de frontera capturando solos $188 mil millones— las empresas están racionalizando a uno o dos proveedores de IA por caso de uso. El principal impulsor es el costo de integración: desplegar IA en flujos de trabajo de producción es costoso, y los costos de cambio se acumulan rápidamente.

El resultado neuro-simbólico introduce una nueva dimensión a la evaluación de proveedores. Las arquitecturas primero-eficiencia reducen los costos continuos de inferencia, hacen práctico el despliegue en el borde, y producen modelos cuyas decisiones se pueden auditar paso a paso — una ventaja de cumplimiento que las cajas negras puramente neuronales no pueden igualar fácilmente.

flowchart LR

subgraph Camino Tradicional

T1[LLM Grande] --> T2[Alto Costo de Computo]

T2 --> T3[Dependencia de Nube]

T3 --> T4[Decisiones Caja Negra]

end

subgraph Camino Neuro-Simbolico

N1[Modelo Hibrido] --> N2[1-5 pct Energia]

N2 --> N3[Despliegue en Borde Viable]

N3 --> N4[Pasos Interpretables]

end

T4 --> C[Friccion en Adopcion Empresarial]

N4 --> D[Ventaja en Adopcion Empresarial]

style D fill:#d4edda

style C fill:#f8d7da| Requisito Empresarial | LLM Puramente Neuronal | Híbrido Neuro-Simbólico |

|---|---|---|

| Explicabilidad / rastro de auditoría | Bajo — outputs estadísticos | Alto — pasos simbólicos son registrados |

| Despliegue en borde / local | Limitado por tamaño del modelo | Práctico a bajo costo energético |

| Cumplimiento regulatorio | Requiere herramientas de interpretabilidad post-hoc | Traza lógica incorporada |

| Precisión en tareas de planificación | Moderada — escala con parámetros | Alta — corrección lógica garantizada |

| Costo de inferencia continua | Alto a escala de producción | Potencialmente 20x menor |

Para CIOs y líderes de productos de IA, la pregunta práctica es si sus casos de uso de IA de mayor valor involucran razonamiento estructurado de múltiples pasos (candidato neuro-simbólico) o generación y comprensión de extremo abierto (donde los modelos neuronales grandes siguen siendo la herramienta correcta). La mayoría de los flujos de trabajo empresariales —optimización de cadena de suministro, planificación de vías clínicas, automatización de procesos robóticos, generación de código para dominios acotados— caen directamente en el punto óptimo neuro-simbólico.

FAQ

¿Qué es la IA neuro-simbólica y en qué se diferencia del aprendizaje profundo estándar? La IA neuro-simbólica fusiona redes neuronales con razonamiento simbólico, descomponiendo primero los problemas en subpasos lógicos, reduciendo drásticamente los datos y el cómputo necesarios, en lugar de tratar cada problema como un desafío de coincidencia estadística de patrones como hace el aprendizaje profundo estándar.

¿Cuánta energía utiliza realmente el nuevo modelo comparado con los estándar? Durante el entrenamiento, utilizó solo el 1% de la energía de los modelos estándar, con el tiempo de entrenamiento cayendo de más de 36 horas a 34 minutos. Durante la operación utilizó el 5%, reduciendo directamente los costos de cómputo en la nube y la huella de carbono.

¿Se sacrificó la precisión para lograr estos ahorros de energía? No, la precisión mejoró drásticamente: 95% de tasa de éxito en la Torre de Hanói vs 34% del modelo estándar, porque el razonamiento simbólico garantiza la corrección lógica en lugar de adivinar estadísticamente.

¿Qué tipos de aplicaciones de IA se benefician más de los enfoques neuro-simbólicos? Aplicaciones que requieren planificación de múltiples pasos, decisiones interpretables u operación bajo restricciones de recursos: robótica, automatización industrial, diagnósticos médicos, despliegue de IA en el borde y automatización de flujos de trabajo empresariales.

¿Significa este avance que la industria dejará de escalar grandes modelos de lenguaje? No, pero señala una bifurcación: los laboratorios de frontera continuarán escalando LLMs para razonamiento general, mientras que la IA orientada a la acción adoptará arquitecturas neuro-simbólicas más eficientes. Los dos paradigmas coexistirán.

¿Cuándo llegará la IA neuro-simbólica a los despliegues de producción? La investigación se presentará en Viena en mayo de 2026. Los fabricantes de robótica industrial típicamente convierten investigación de etapa de conferencia en producción en 18 a 36 meses, y las plataformas de software empresarial pueden ser aún más rápidas.

無程式碼也能輕鬆打造專業LINE官方帳號!一鍵導入模板,讓AI助你行銷加分!

無程式碼也能輕鬆打造專業LINE官方帳號!一鍵導入模板,讓AI助你行銷加分!