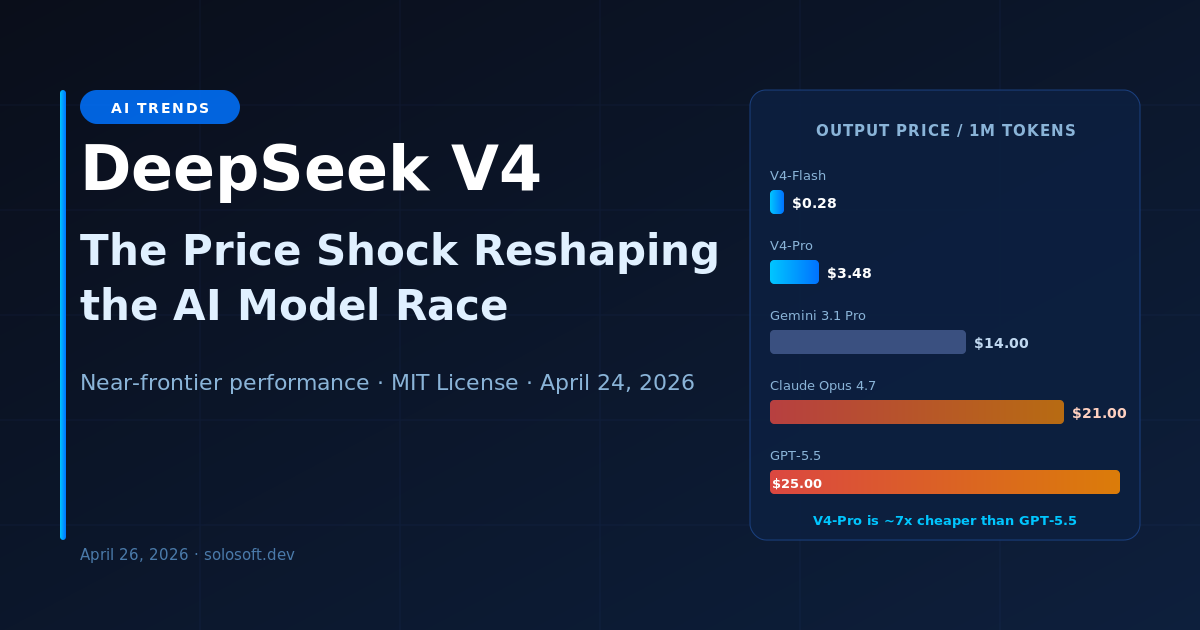

2026 年 4 月 24 日,DeepSeek 发布了两款新模型 — V4-Pro 与 V4-Flash — 立即震撼了所有企业 AI 预算中的定价假设。V4-Pro 的输出成本每百万 token 仅 3.48 美元,约为 GPT-5.5 的七分之一、Claude Opus 4.7 的六分之一。对于任何规模的生产环境 — 代码助手、RAG 流水线、客服自动化 — 这个数字都难以忽视。这不是小幅渐进式更新,而是一场结构性定价战的最新一章:中国 AI 实验室正利用资本高效架构与更低的运营成本,以市场难以消化的速度压缩「每单位智能成本」。

这个故事不仅关乎价格。DeepSeek V4-Pro 在 SWE-bench Verified 评分高达 80.6%,仅落后目前排名第一的美国模型 Claude Opus 4.6 的 0.2 个百分点。在衡量真实生产环境表现的代码基准(如 LiveCodeBench 与 Terminal-Bench 2.0)上,V4-Pro 甚至全面领先所有前沿模型。此外,DeepSeek 深化了与华为昇腾芯片的整合 — 这是对美国出口管制的直接回应,也是一项战略性供应链宣示。2026 年的 AI 竞赛正同时在基准测试、定价与芯片自主三条战线上展开。

DeepSeek V4 是什么?为何如此重要?

DeepSeek V4 包含 V4-Pro 与 V4-Flash 两款模型,均采用混合专家架构(MoE),并于 2026 年 4 月 24 日以 MIT 授权发布。V4-Pro 以最大性能为目标,拥有 1.6 万亿总参数(每 token 激活 490 亿);V4-Flash 以效率为导向,共 2840 亿参数(激活 130 亿)。两款模型均在 32 至 33 万亿 token 上训练,并通过混合注意力架构支持 100 万 token 上下文窗口。

关键在于这几项的组合:接近前沿的性能、开放权重、MIT 授权、以及比所有美国竞品低六至十倍的定价。对企业市场而言,问题已不再是「我们负担得起前沿 AI 吗?」,而是「为何我们在那些 V4-Pro 已经足够好的任务上,还要支付前沿价格?」

DeepSeek V4 与 OpenAI 和 Anthropic 相比如何?

DeepSeek V4-Pro 在多数基准测试上仅落后绝对前沿 3 至 6 个月,却拥有七分之一的 API 成本。在企业 LLM 支出占比最高的代码专项任务上,它甚至全面领先所有竞品。

| 模型 | 厂商 | 总参数 | 激活参数 | 上下文窗口 | SWE-bench Verified | 输出价格 / 百万 token |

|---|---|---|---|---|---|---|

| DeepSeek V4-Pro | DeepSeek | 1.6T | 49B | 100 万 | 80.6% | $3.48 |

| DeepSeek V4-Flash | DeepSeek | 284B | 13B | 100 万 | ~65% | $0.28 |

| Claude Opus 4.7 | Anthropic | 未公开 | 未公开 | 20 万 | ~82% | ~$21.00 |

| GPT-5.5 | OpenAI | 未公开 | 未公开 | 12.8 万 | ~81% | ~$25.00 |

| Gemini 3.1 Pro | 未公开 | 未公开 | 200 万 | ~79% | ~$14.00 |

表格揭示了核心矛盾:若所有模型在 SWE-bench Verified 上的差距仅有 1 至 2 个百分点,6 至 10 倍的价格差距便成为多数生产工作负载的主要决策变量。

V4-Pro 的架构为何如此高效?

DeepSeek V4 采用混合专家架构(MoE),每次推理只激活全体参数的一小部分。V4-Pro 不会对每个 token 通过所有 1.6 万亿参数,而是每次仅激活 490 亿。这在不牺牲大参数模型知识广度的前提下,大幅降低了推理计算成本。

flowchart TD

Input[输入 Token 流] --> Router[MoE 门控路由器<br>依 Token 类型学习]

Router --> E1[代码专家集群]

Router --> E2[推理专家集群]

Router --> E3[语言专家集群]

Router --> EN[领域专家 N]

E1 --> Agg[加权输出聚合]

E2 --> Agg

E3 --> Agg

EN --> Agg

Agg --> Out[最终模型响应]搭配混合注意力架构,V4-Pro 实现了多数企业用户真正需要的能力:大上下文、强代码、合理推理 — 且推理成本随激活参数数量扩展,而非总参数量。

DeepSeek V4 的定价到底有多低?

DeepSeek V4 与美国前沿模型之间的定价差距,绝非四舍五入的误差 — 而是一种在规模下持续复利的结构性成本差异。

| 模型 | 输入价格 / 百万 token | 输出价格 / 百万 token | 缓存输入价格 / 百万 token | 授权 |

|---|---|---|---|---|

| DeepSeek V4-Flash | $0.07 | $0.28 | $0.018 | MIT |

| DeepSeek V4-Pro | $1.74 | $3.48 | $0.43 | MIT |

| Gemini 3.1 Pro | ~$5.00 | ~$14.00 | ~$1.25 | 专有 |

| Claude Opus 4.7 | ~$7.00 | ~$21.00 | ~$1.75 | 专有 |

| GPT-5.5 | ~$10.00 | ~$25.00 | ~$2.50 | 专有 |

以每月 100 亿输出 token(中型企业的合理用量)计算,V4-Pro 与 GPT-5.5 的月费差异约为 2.15 亿对 2.5 亿美元。一年下来的节省超过部署一支内部 AI 团队的成本。

DeepSeek V4-Pro 在哪些基准测试中真正领先?

V4-Pro 在代码基准上领先业界,在广域推理与知识测试上略落后绝对前沿。这是刻意的优化取舍:企业花费最多算力的工作负载,恰好是 V4-Pro 表现最佳的领域。

| 基准测试 | DeepSeek V4-Pro | Claude Opus 4.6 | GPT-5.5 | Gemini 3.1 Pro | 衡量内容 |

|---|---|---|---|---|---|

| SWE-bench Verified | 80.6% | 80.8% | ~81.0% | ~79.0% | 真实 GitHub Issue 解决能力 |

| LiveCodeBench | 93.5% | 88.8% | ~90.0% | ~88.5% | 竞赛编程题目 |

| Terminal-Bench 2.0 | 67.9% | 65.4% | ~64.0% | ~63.0% | 自主 CLI 任务完成率 |

| Codeforces 评分 | 3206 | ~3150 | ~3100 | ~3050 | 竞赛编程排名 |

| MMLU Pro | ~76% | ~80% | ~81% | ~80% | 研究生程度知识 |

| Humanity’s Last Exam | ~44% | ~52% | ~54% | ~51% | 博士程度推理 |

华为芯片整合传递了什么战略信号?

DeepSeek V4 与华为昇腾芯片的深度整合并非备用方案,而是一项战略宣示:中国 AI 技术栈可以在不依赖英伟达硬件的情况下,以接近前沿的规模运行。

flowchart LR

V1[DeepSeek V1<br>2023<br>首款开源模型] --> V2[DeepSeek V2<br>2024<br>MoE 架构]

V2 --> R1[DeepSeek R1<br>2025 年 1 月<br>推理能力震撼]

R1 --> V3[DeepSeek V3<br>2024 年 12 月<br>前沿基准主张]

V3 --> V4[DeepSeek V4-Pro<br>2026 年 4 月<br>定价与芯片自主]昇腾整合有三项战略意涵:降低对未来美国硬件制裁的曝险;打造从芯片到模型不依赖美国供应链的垂直整合技术栈;以及证明华为昇腾芯片在软件栈针对性优化后,确实能以接近前沿的规模训练并服务模型。

企业应如何回应这波定价冲击?

面对 DeepSeek V4 的发布,理性回应是系统性的工作负载审计,而非全面迁移。企业应按任务类型梳理现有 LLM 支出,针对每个使用场景评估基准接近程度,并在进行基础设施变更前计算实际的成本节省空间。

更深层的战略意涵是:DeepSeek V4 是 15 个月内(继 2025 年 1 月的 R1 之后)第二次迫使美国 AI 业界重新审视定价假设的中国模型发布。若这个节奏持续,两三年内多数工作负载的前沿接近智能成本将趋近于零。可防御的护城河不是廉价 token 的访问,而是专有数据、用户信任,以及任何模型替换都无法复制的工作流程深度。

常见问题

DeepSeek V4 是什么?何时发布? DeepSeek V4 是 2026 年 4 月 24 日发布的大型语言模型系列,包含 V4-Pro 与 V4-Flash,均采用 MoE 架构与 MIT 授权,可免费用于商业应用。

DeepSeek V4-Pro 的定价与竞品相比如何? V4-Pro 输出 token 每百万 3.48 美元,约为 GPT-5.5 的七分之一,启用缓存后差距可达十分之一。

DeepSeek V4-Pro 在哪些代码基准中领先? 在 Terminal-Bench 2.0(67.9%)、LiveCodeBench(93.5%)及 Codeforces 评分(3206)均居前沿之首;SWE-bench Verified 达 80.6%。

DeepSeek V4 是开源的吗? 是的,两款模型均以 MIT 授权发布,可免费下载、微调并商业部署。

DeepSeek V4 的混合注意力架构是什么? 一种支持 100 万 token 上下文窗口的技术,允许整个代码库或书本长度的文档作为单一提示词提交。

企业应该换成 DeepSeek V4 吗? 代码与文档工作负载是强力候选;高度监管行业应先评估数据驻留与合规性。务实做法是逐工作负载审计。