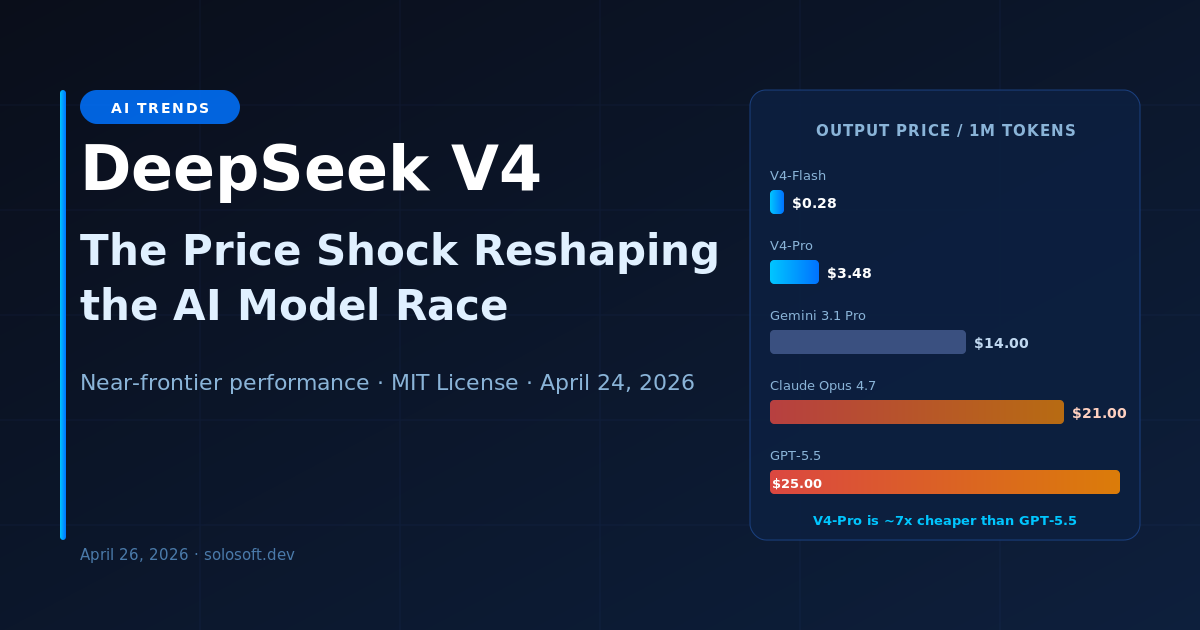

2026 年 4 月 24 日,DeepSeek 發布了兩款新模型 — V4-Pro 與 V4-Flash — 立即震撼了所有企業 AI 預算中的定價假設。V4-Pro 的輸出成本每百萬 token 僅 3.48 美元,約為 GPT-5.5 的七分之一、Claude Opus 4.7 的六分之一。對於任何規模的生產環境 — 程式碼助理、RAG 流水線、客服自動化 — 這個數字都很難忽視。這不是小幅漸進式更新,而是一場結構性定價戰的最新一章:中國 AI 實驗室正在利用資本高效架構與更低的運營成本,以市場難以消化的速度壓縮「每單位智慧成本」。

這個故事不僅僅關乎價格。DeepSeek V4-Pro 在 SWE-bench Verified 評分高達 80.6%,僅落後目前排名第一的美國模型 Claude Opus 4.6 的 0.2 個百分點。在衡量真實生產環境表現的程式碼基準(如 LiveCodeBench 與 Terminal-Bench 2.0)上,V4-Pro 甚至全面領先所有前沿模型。此外,DeepSeek 深化了與華為昇騰晶片的整合 — 這是對美國出口管制的直接回應,也是一項戰略性供應鏈宣示。2026 年的 AI 競賽正同時在基準測試、定價與晶片自主三條戰線上展開。

DeepSeek V4 是什麼?為何如此重要?

DeepSeek V4 包含 V4-Pro 與 V4-Flash 兩款模型,均採用混合專家架構(MoE),並於 2026 年 4 月 24 日以 MIT 授權發布。V4-Pro 以最大效能為目標,擁有 1.6 兆總參數(每 token 啟用 490 億);V4-Flash 以效率為導向,共 2840 億參數(啟用 130 億)。兩款模型均在 32 至 33 兆 token 上訓練,並透過混合注意力架構支援 100 萬 token 上下文視窗。

關鍵在於這幾項的組合:接近前沿的效能、開放權重、MIT 授權、以及比所有美國競品低六至十倍的定價。對企業市場而言,問題已不再是「我們負擔得起前沿 AI 嗎?」,而是「為何我們在那些 V4-Pro 已經夠好的任務上,還要支付前沿價格?」

DeepSeek V4 與 OpenAI 和 Anthropic 相比如何?

DeepSeek V4-Pro 在多數基準測試上僅落後絕對前沿 3 至 6 個月,卻擁有七分之一的 API 成本。在企業 LLM 支出佔比最高的程式碼專項任務上,它甚至全面領先所有競品。

| 模型 | 廠商 | 總參數 | 啟用參數 | 上下文視窗 | SWE-bench Verified | 輸出價格 / 百萬 token |

|---|---|---|---|---|---|---|

| DeepSeek V4-Pro | DeepSeek | 1.6T | 49B | 100 萬 | 80.6% | $3.48 |

| DeepSeek V4-Flash | DeepSeek | 284B | 13B | 100 萬 | ~65% | $0.28 |

| Claude Opus 4.7 | Anthropic | 未公開 | 未公開 | 20 萬 | ~82% | ~$21.00 |

| GPT-5.5 | OpenAI | 未公開 | 未公開 | 12.8 萬 | ~81% | ~$25.00 |

| Gemini 3.1 Pro | 未公開 | 未公開 | 200 萬 | ~79% | ~$14.00 |

表格揭示了核心矛盾:若所有模型在 SWE-bench Verified 上的差距僅有 1 至 2 個百分點,6 至 10 倍的價格差距便成為多數生產工作負載的主要決策變數。

V4-Pro 的架構為何如此高效?

DeepSeek V4 採用混合專家架構(MoE),每次推理只啟用全體參數的一小部分。V4-Pro 不會對每個 token 通過所有 1.6 兆參數,而是每次僅啟用 490 億。這在不犧牲大參數模型知識廣度的前提下,大幅降低了推理運算成本。

MoE 路由器在訓練期間學習哪些專家子網路最擅長哪類任務。程式碼 token 導向程式碼專家,推理 token 導向邏輯專家。結果是一個擁有 1.6T 模型知識表面、卻只需 49B 模型推理成本的架構。

flowchart TD

Input[輸入 Token 串流] --> Router[MoE 閘控路由器<br>依 Token 類型學習]

Router --> E1[程式碼專家群集]

Router --> E2[推理專家群集]

Router --> E3[語言專家群集]

Router --> EN[領域專家 N]

E1 --> Agg[加權輸出聚合]

E2 --> Agg

E3 --> Agg

EN --> Agg

Agg --> Out[最終模型回應]搭配混合注意力架構,V4-Pro 實現了多數企業使用者真正需要的能力:大上下文、強程式碼、合理推理 — 且推理成本隨啟用參數數量擴展,而非總參數量。

DeepSeek V4 的定價到底有多低?

DeepSeek V4 與美國前沿模型之間的定價差距,絕非四捨五入的誤差 — 而是一種在規模下持續複利的結構性成本差異。

| 模型 | 輸入價格 / 百萬 token | 輸出價格 / 百萬 token | 快取輸入價格 / 百萬 token | 授權 |

|---|---|---|---|---|

| DeepSeek V4-Flash | $0.07 | $0.28 | $0.018 | MIT |

| DeepSeek V4-Pro | $1.74 | $3.48 | $0.43 | MIT |

| Gemini 3.1 Pro | ~$5.00 | ~$14.00 | ~$1.25 | 專有 |

| Claude Opus 4.7 | ~$7.00 | ~$21.00 | ~$1.75 | 專有 |

| GPT-5.5 | ~$10.00 | ~$25.00 | ~$2.50 | 專有 |

以每月 100 億輸出 token(一家中型企業的合理用量)計算,V4-Pro 與 GPT-5.5 的月費差異約為 2.15 億對 2.5 億美元。一年下來的節省超過部署一支內部 AI 團隊的成本。對新創公司而言,V4-Flash 每百萬輸出 token 僅 0.28 美元,在小規模應用中幾乎等同於零成本。

DeepSeek V4-Pro 在哪些基準測試中真正領先?

V4-Pro 在程式碼基準上領先業界,在廣域推理與知識測試上略落後絕對前沿。這是刻意的優化取捨:企業花費最多算力的工作負載,恰好是 V4-Pro 表現最佳的領域。

| 基準測試 | DeepSeek V4-Pro | Claude Opus 4.6 | GPT-5.5 | Gemini 3.1 Pro | 衡量內容 |

|---|---|---|---|---|---|

| SWE-bench Verified | 80.6% | 80.8% | ~81.0% | ~79.0% | 真實 GitHub Issue 解決能力 |

| LiveCodeBench | 93.5% | 88.8% | ~90.0% | ~88.5% | 競賽程式設計題目 |

| Terminal-Bench 2.0 | 67.9% | 65.4% | ~64.0% | ~63.0% | 自主 CLI 任務完成率 |

| Codeforces 評分 | 3206 | ~3150 | ~3100 | ~3050 | 競賽程式設計排名 |

| MMLU Pro | ~76% | ~80% | ~81% | ~80% | 研究所程度知識 |

| Humanity’s Last Exam | ~44% | ~52% | ~54% | ~51% | 博士程度推理 |

模式清晰:V4-Pro 在應用程式碼上勝出,在廣域推理上落後。對大多數企業 LLM 工作負載(程式碼生成、PR 審查、文件、代理軟體任務),這個取捨極為有利。

華為晶片整合傳遞了什麼戰略訊號?

DeepSeek V4 與華為昇騰晶片的深度整合並非備用方案,而是一項戰略宣示:中國 AI 技術堆疊可以在不依賴輝達硬體的情況下,以接近前沿的規模運行。美國出口管制切斷了先進 GPU 存取,DeepSeek 沒有放慢腳步,而是選擇優化。

flowchart LR

V1[DeepSeek V1<br>2023<br>首款開源模型] --> V2[DeepSeek V2<br>2024<br>MoE 架構]

V2 --> R1[DeepSeek R1<br>2025 年 1 月<br>推理能力震撼]

R1 --> V3[DeepSeek V3<br>2024 年 12 月<br>前沿基準主張]

V3 --> V4[DeepSeek V4-Pro<br>2026 年 4 月<br>定價與晶片自主]昇騰整合有三項戰略意涵。第一,降低 DeepSeek 對未來美國硬體制裁的曝險。第二,從晶片到模型打造垂直整合的中國 AI 技術堆疊,在任何層面都不依賴美國供應鏈。第三,證明曾被視為次等的華為昇騰晶片,在軟體堆疊針對性優化後,確實能以接近前沿的規模訓練並服務模型。這正是 AI 晶片版本的 Apple Silicon:押注垂直整合勝過商用硬體。

企業應如何回應這波定價衝擊?

面對 DeepSeek V4 的發布,理性回應是系統性的工作負載審計,而非全面遷移。企業應按任務類型梳理現有 LLM 支出,針對每個使用場景評估基準接近程度,並在進行基礎設施變更前計算實際的成本節省空間。

正確決策取決於三個因素:任務敏感度(此工作負載需要絕對前沿推理,還是接近前沿即可?)、資料治理要求(輸入與輸出需在哪裡駐留?)、以及遷移複雜度(現有技術堆疊與特定廠商 API 的耦合程度如何?)。

在程式碼、文件處理、摘要、RAG 工作負載上,遷移至 V4-Pro 的案例相當充分。對於複雜多步推理、受監管的敏感資料,或與 OpenAI / Anthropic 生態系深度整合的工作負載,判斷則更為複雜。

更深層的戰略意涵是:DeepSeek V4 是 15 個月內(繼 2025 年 1 月的 R1 之後)第二次迫使美國 AI 業界重新審視定價假設的中國模型發布。若這個節奏持續,兩三年內,多數工作負載的前沿接近智慧成本將趨近於零。在這個世界中,可防禦的護城河不是廉價 token 的存取,而是專有資料、使用者信任,以及任何模型替換都無法複製的工作流程深度。

常見問題

DeepSeek V4 是什麼?何時發布? DeepSeek V4 是 DeepSeek 於 2026 年 4 月 24 日發布的大型語言模型家族,包含 V4-Pro 與 V4-Flash,均採用 MoE 架構與 MIT 授權,可免費用於商業應用。

DeepSeek V4-Pro 的定價與 GPT-5.5 和 Claude Opus 4.7 相比如何? V4-Pro 輸出 token 每百萬 3.48 美元,約為 GPT-5.5 的七分之一、Claude Opus 4.7 的六分之一,啟用快取後差距可達十分之一。

DeepSeek V4-Pro 在哪些程式碼基準測試中領先? 在 Terminal-Bench 2.0(67.9%)、LiveCodeBench(93.5%)及 Codeforces 評分(3206)均居前沿之首;SWE-bench Verified 達 80.6%,落後領先者 0.2 個百分點。

DeepSeek V4 是開源的嗎? 是的,兩款模型均以 MIT 授權發布,可免費下載、微調並商業部署,無需支付 API 費用。

DeepSeek V4 的混合注意力架構是什麼? 一種支援 100 萬 token 上下文視窗的技術,允許整個程式碼庫或書本長度的文件作為單一提示詞提交,直接競爭 Gemini 3.1 Pro 與 Claude Opus 4.7 的長文本企業應用場景。

企業應該換成 DeepSeek V4 嗎? 程式碼與文件工作負載是強力候選;高度監管行業應先評估資料駐留與出口管制合規性。務實做法是逐工作負載審計,而非全面遷移。